7. Картинки с потерями#

Important

Задачка не доделана. Я хочу собрать разных динамик функций потерь и посрашивать о том, что происходит на графиках. Оказалось, что сгенерировать подходящие данные сложновато.

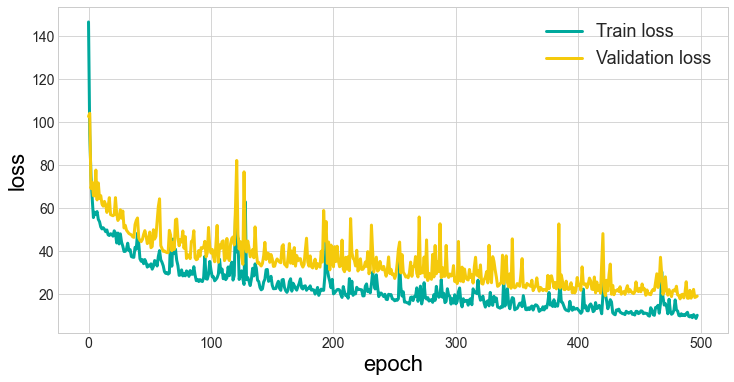

Маша обучает нейросеть. На каждой эпохе она замеряет качество нейросети на обучающей и валидационной выборках и рисует картинки с динамикой качества модели. По оси абсцисс откладывается номер эпохи, по оси ординат откладывается значение функции потерь.

а) Во время обучения маша увидела следующие динамику потерь. Что означает такая динамика? Что Маше следует сделать?

Решение

Нормализация данных

б) А что означает такая динамика? Что можно сделать, что с нейросеткой всё стало хорошо?

Решение

Переобучение + рання остановка

в) А теперь?

Решение

Забыли перемешеть

г) А тут?

Решение

Взрыв градиента

д) А теперь?

Решение

Толи затухание толи доучились толи еще что …

е) Маша Н. и Дима В. …

Решение

двойной спуск

ё) Дима рассказал Маше как вчера обучал модель. Дима решал задачу бинарной классификации и обучал модель на логистические потери, logloss. Параллельно Дима наблюдал за тем, как ведёт себя доля правильных ответов, accuracy.

На обучающей выборке accuracy и logloss всё время улучшались. На тесте, начиная с какой-то эпохи, logloss начал ухудшаться, но accuracy, при этом, продолжил улучшаться. Может ли такой быть или Дима врёт? Если да, почему это произошло и как можно это починить?

Решение

Important

Хочется придумать примеров, где мы оптимизируем какую-то функцию потерь, а качество измеряем по ортогональной метрике и всё ломается.